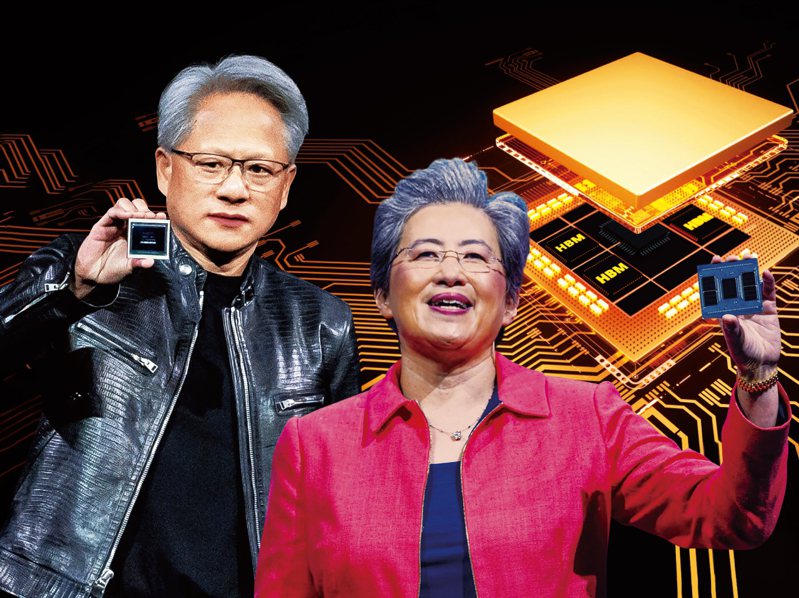

為何輝達和超微都在搶HBM?

【文/魏聖峰】

HBM解決傳統DRAM記憶體限制訊息流通的問題,透過同一封裝內晶片的矽中介質和SoC集成在一起,克服數據I/O封裝管腳限制的最大數量,突破DDR寬帶限制的問題,讓AI離不開HBM。SK海力士目前市佔率超過五成,有主宰HBM價格的能力。

過去記憶體常常擺脫不了景氣循環的宿命,隨着科技進入AI世代,伴隨着對高頻寬記憶體(HBM)的需求,讓記憶體有新的轉機。Nvidia執行長黃仁勳曾經表示,若GPU要順利推動ChatGTP等最先進生成式AI,要最大限度地發揮GPU性能,必須有HBM。今年Nvidia搭配AI處理器平臺的HBM的主流規格是HBM3和HBM3e,下一世代GPU平臺Rubin(二○二六年推出)就要採用HBM4,屆時誰能搶到較多的市佔率,將有機會主宰HBM領導角色。

HBM產能供不應求

黃仁勳對HBM曾經有過這樣的評論,就是買越多、省越多!難道HBM價格是比傳統記憶體DRAM便宜嗎?當然不是這樣!HBM作爲先進的記憶體,它的技術比傳統DRAM技術困難很多,由於廠商目前在HBM的良率還不是很高(僅約五○∼六○%),工序複雜,價格當然不會便宜。在GPU跨入AI世代時,只有DDR5/HBM纔有辦法在AI高倍速(HCP)的環境下運作,其他規格的記憶體都不行,加上全世界只有SK海力士、美光科技和三星電子等的記憶體大廠製程有能力做出HBM,以至於產能有限,市場供不應求,HBM目前是賣方喊價的市場。

隨着市場對HBM需求越來越大,SK海力士、美光科技和三星電子等三大記憶體制造商未來的資本支出會大幅用來生產HBM,並且會逐步把之前生產較低階DRAM生產線,逐步改爲HBM生產線。根據集邦科技的統計,去年底HBM佔整體DRAM產能約八%,市場規模四三.五六億美元、年成長率達一一○%。預估到今年底,HBM在DRAM的比重將有機會達到二○%、一六九.一億美元的產值。HBM的生產週期比DDR5更長,從投片到產出與封裝完成需要兩個季度以上,生產週期(包含TSV)會比DD5多出一.五∼二個月以上不等,對HBM買家來說,都要及早規劃預定,否則有錢也買不到。目前這三大廠針對今年的產能都已經預訂一空,SK海力士日前宣佈明年的產能都被預訂一空,美光科技明年的產能也差不多被訂完。

不過,最近傳出三星電子沒有通過Nvidia的認證,主要是因爲過熱和功耗有問題。據瞭解,從去年起三星電子一直嘗試通過Nvidia的第四代HBM3和第五代HBM3e的認證,但到日前爲止,三星電子八層與十二層堆疊的HBM3與HBM3e都未通過認證。三星電子沒通過Nvidia就無法打入Nvidia的供應鏈,目前也只能供應超微和其他CSP客戶,這會讓三星電子在未來的HBM市場被弱化,畢竟打不進Nvidia供應鏈就等於沒打進主流市場。這個情況,可能會讓SK海力士會在HBM的主宰力更大,價格會更硬,這也是Nvidia和超微不樂見的現象。去年底HBM市佔率中,SK海力士擁有高達五成的市佔率、三星電子約四成、美光科技僅一成。美光科技最大的問題就是產能不足,未來要觀察美光科技在一β製程已經開出來後,能否提高HBM產能,來搶佔三星電子空出來的市佔率。

黃仁勳四日在COMPUTEX會場中表示,SK海力士和美光科技已是Nvidia的HBM供應鏈,而三星電子還在努力中。言下之意,Nvidia仍期待三星電子能通過認證,成爲HBM供應鏈的一環。

解決傳統DRAM許多問題

HCP是進入AI領域的必經過程,且在短期間內要處理最多的大數據資料。HBM會成爲AI的必需品,在技術上HBM解決了傳統DRAM遇到的內存高牆(Memory Wall)問題,這問題限制數據無法流通,是傳統DRAM無法用在AI用途的原因。HBM利用獨特的矽穿孔(TSV)技術,讓訊息透過矽中介層能緊湊地讓數據連結GPU。如此能節省數據傳輸的時間延遲與耗能問題。HBM是以數個DDR堆疊方式形成,從四層、八層到十二層不等,形成大容量和高寬帶的DDR組合陣列。採用堆疊方式最高能節省九四%的晶片面積,HBM透過同一封裝內的矽中介層與SoC集成在一起,能夠克服數據I/O封裝管腳限制的最大數量,進而突破內存寬帶的限制。綜合來看,高寬帶、低延遲、低功耗以及高效傳輸等特性,讓HBM成爲AI運作過中記憶體的首選。

隨着AI算力提升,對周邊設備規格的要求也越來越嚴謹。根據Nvidia官網顯示,以A100當時搭配HBM2e的效能爲基礎,二三年的H100搭配HBM3時,運作效能比A100提高十一倍,而H200搭配HBM3e的運作效能更比A100提高十八倍,即將在今年下半年推出的B100搭配HBM3e的效能,又比H200的效能至少再高出一倍。

【全文詳情及圖表請見《先探投資週刊》2303期;訂閱先探投資週刊電子版】